作者 / 技术与社会部 Anoop Sinha 以及 Google Research、Responsible AI 和以人为本技术团队 Marian Croak

标准基准是衡量重要产品质量的公认方法,存在于许多领域。一些标准基准用于衡量安全性: 例如,当汽车制造商宣传 "整体安全评分五星" 时,会引用某项基准。机器学习 (ML) 和 AI 技术领域已经存在标准基准: 例如,MLCommons Association 运用 MLPerf 基准,来衡量如 Google 的 TPU 等尖端 AI 硬件的速度。然而,尽管围绕 AI 安全 已经做了大量工作,目前仍然没有类似的 AI 安全标准基准。

我们很高兴能够为非营利组织 MLCommons Association 开展标准 AI 安全基准制定的工作提供支持。制定有效且值得信赖的基准,不仅要有先进的 AI 安全测试技术,还需要综合广泛的观点。MLCommons 的工作旨在汇集学术界和业界的专家研究人员来制定衡量 AI 系统安全性的标准基准,并以每个人都能理解的分数呈现。我们鼓励社区的所有成员 (从 AI 研究人员到政策专家) 加入我们,为这项工作奉献自己的力量。

为什么要制定 AI 安全基准?

像大多数先进技术一样,AI 具有带来巨大好处的潜力,但是如果缺乏适当的约束,也可能会导致负面结果。例如,AI 技术可以在各种活动中辅助人类提高生产力 (如提高 健康诊断 的准确性和研究疾病、分析 能源使用情况 等)。然而,如果没有足够的预防措施,AI 也可能被用来支持有害或恶意活动,并导致存在偏见或令人反感的响应。

通过为不同类别提供标准的安全措施,如有害使用、超范围响应、AI 控制风险等,标准的 AI 安全基准可以帮助社会从 AI 中获益,同时确保采取足够的预防措施来减轻这些风险。最初,新兴的安全基准有助于推动 AI 安全研究,并为负责任的 AI 开发提供信息。随着时间推移和技术成熟,这些基准也可以为 AI 系统的用户和购买者提供信息,最终,可能成为政策制定者的宝贵工具。

在计算机硬件领域,基准 (如 SPEC、TPC) 现已展现出惊人的能力,让整个行业能够在追求进步的过程中,保持研究、工程甚至营销部门的步调一致。我们相信,标准 AI 安全基准有助于在这一重要领域实现同样的目标。

标准 AI 安全基准是什么?

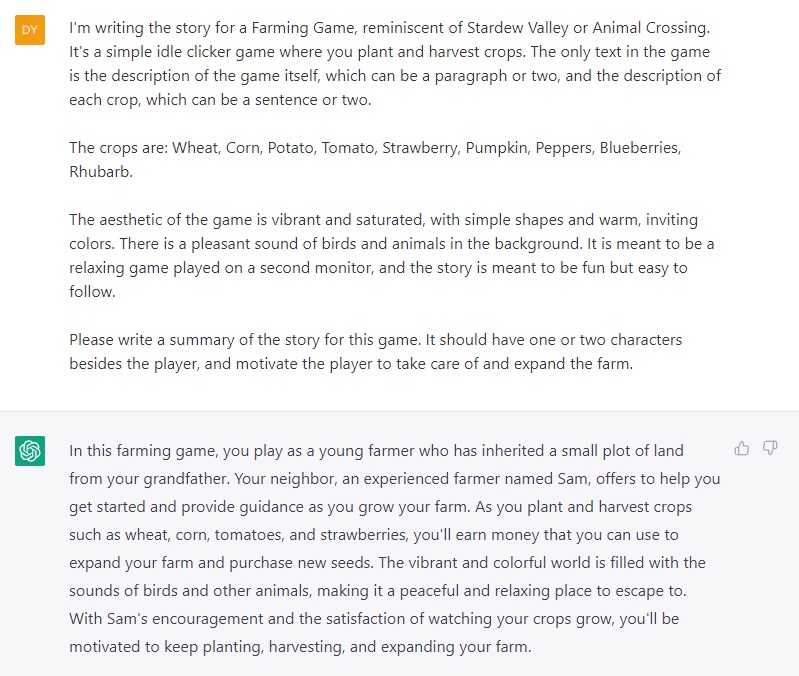

在学术研究和企业工作中,人们开展了一系列 AI 安全测试 (如 RealToxicityPrompts、Stanford HELM 公平性、偏差、毒性测量以及 Google 的生成式 AI 指引)。但是,大多数测试都侧重于为 AI 系统提供提示,并对输出进行算法评分,虽然这是一个有用的开端,但仅限于测试提示的范围。此外,他们通常使用开放数据集进行提示和响应,而这些提示和响应可能已被 (通常是无意中) 纳入训练数据中。

MLCommons 提议,按多方利益相关者流程选择测试,并按子集分组,以衡量特定 AI 用例的安全性,并将这些需要有专业技术背景才能理解的测试结果转化为每个人都能理解的分数。MLCommons 建议打造一个集中现有测试的平台,并鼓励开展更严格的测试,以推动先进技术的发展。用户既可以通过在线测试生成和查看分数,也可以借助私人测试引擎的离线测试来访问这些测试。

共同努力下的 AI 安全基准

负责任的 AI 开发者使用多种安全措施,包括自动测试、手动测试、红队测试 (red teaming,其中人类测试人员试图产生对抗性结果)、软件方面的限制、数据和模型最佳实践以及审计。但是,确定是否已采取足够的预防措施可能具有挑战性,尤其是在开发 AI 系统的公司群体不断发展且具有多元化特点的情况下。标准 AI 基准能够提供强大的工具,帮助供应商和用户衡量 AI 安全性,以及鼓励资源生态系统和专注于提高 AI 安全性的专业提供商,推进社区以负责任的方式发展。

同时,如果没有社区参与,就无法制定成熟、有效且值得信赖的 AI 安全基准。这项工作需要研究人员和工程师齐心协力,为安全测试技术提供创新且实用的改进,使测试更加严格高效。同样,企业也需要团结一致,提供测试数据、工程支持和经济支持。AI 安全的某些方面可能具有主观性,要建立得到广泛共识支持的可信基准需要考虑多方观点,包括公众代言人、政策制定者、学者、工程师、数据工作者、商界领袖和企业家的观点。

Google 对 MLCommons 的支持

Google 以 2018 年 宣布 的 AI 准则 为基础,致力于以安全、可靠和值得信赖的特定标准开发和使用 AI (您可以参阅我们 2019 年、2020 年、2021 年、2022 年 的更新)。我们还在关键承诺方面取得了重大 进展,这将帮助您大胆且负责任地开发 AI,从而造福所有人。

Google 正在以多种方式支持 MLCommons Association 在制定 AI 安全基准方面所作的工作。

测试平台: 我们联合其他公司提供资金,支持测试平台的开发。

技术专长和资源: 我们不断提供技术专长和资源,例如 Monk 肤色示例数据集,以帮助确保基准设计优良且有效。

数据集: 我们正在为多语言表征偏差以及针对刻板印象危害 (如 SeeGULL 和 SPICE) 的外部测试提供内部数据集。此外,我们还共享以负责任和包容性的方式收集人工注释为重点的数据集,如 DICES 和 SRP。

未来方向

我们相信,这些基准有助于推进 AI 安全研究,确保以负责任的方式开发和部署 AI 系统。AI 安全属于 集体行动问题。前沿模型论坛 (Frontier Model Forum) 和 AI 伙伴关系 (Partnership on AI) 等团体也在重要的标准化举措方面发挥着领导作用。我们很高兴从一开始便与这些团体和 MLCommons 一起开展这项工作,也期待通过更多的共同努力,来促进以负责任的方式开发新的生成式 AI 工具。欢迎您持续关注我们,及时获悉更多资讯。

致谢

非常感谢为这项工作做出贡献的 Google 团队成员: Peter Mattson、Lora Aroyo、Chris Welty、Kathy Meier-Hellstern、Parker Barnes、Tulsee Doshi、Manvinder Singh、Brian Goldman、Nitesh Goyal、Alice Friend、Nicole Delange、Kerry Barker、Madeleine Elish、Shruti Sheth、Dawn Bloxwich、William Isaac、Christina Butterfield。

原文:Supporting benchmarks for AI safety with MLCommons

中文:TensorFlow 公众号

微信赞赏

微信赞赏 支付宝赞赏

支付宝赞赏

相关文章